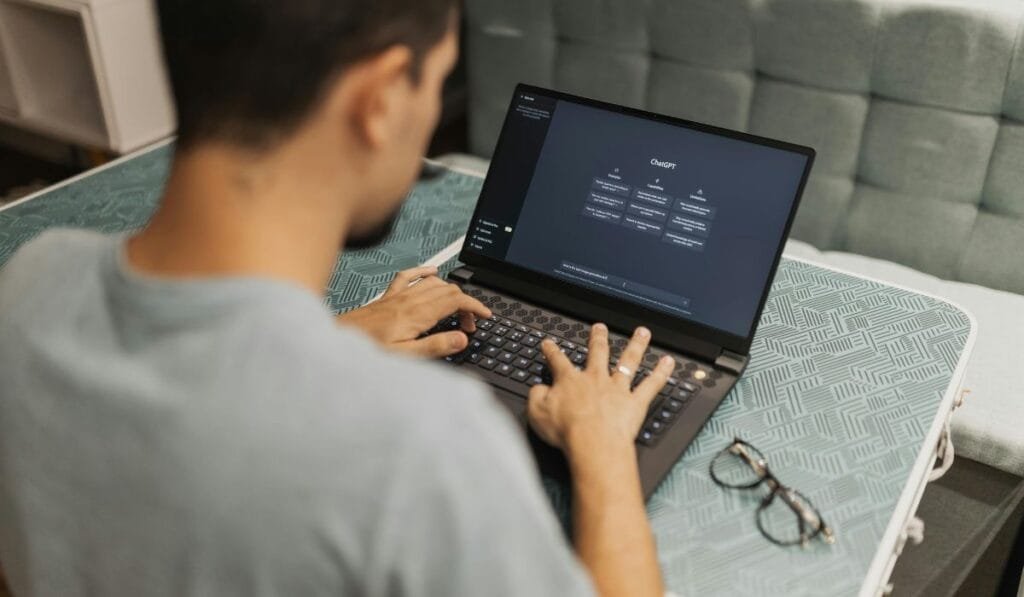

Uma história chocante vinda da Ásia escancarou um lado sombrio da inteligência artificial: criminosos têm usado o ChatGPT como ferramenta para dar golpes em vítimas ao redor do mundo. Duncan Okindo, jovem queniano de 26 anos, contou à Reuters que foi atraído para a Tailândia com a promessa de um emprego em atendimento ao cliente, mas acabou sequestrado e forçado a trabalhar em um complexo fraudulento na fronteira entre Mianmar e Tailândia.

Lá, ao lado de centenas de outros trabalhadores em condições análogas à escravidão, Okindo era obrigado a usar versões gratuitas do ChatGPT para criar mensagens persuasivas. O objetivo: convencer corretores de imóveis americanos a investir em esquemas de criptomoedas que não existiam.

Segundo ele, o ChatGPT ajudava os golpistas a parecerem mais convincentes, simulando sotaques, expressões típicas dos EUA e até respondendo a perguntas técnicas sobre criptografia ou mercado imobiliário em tempo real. O esquema seguia um roteiro conhecido como “pig butchering” (“abate de porcos”), no qual a confiança da vítima é cultivada por semanas antes do golpe final.

Okindo relata que quem não atingia as metas era punido com espancamentos e choques elétricos. Após meses de sofrimento, conseguiu ser libertado em uma operação das autoridades tailandesas.

Alerta do próprio CEO da OpenAI

O caso reforça uma preocupação crescente já destacada pelo próprio CEO da OpenAI, Sam Altman, criadora do ChatGPT. Em um discurso recente no Federal Reserve, em Washington, Altman alertou que o mundo pode estar à beira de uma “crise global de fraudes” potencializada pela inteligência artificial.

Ele citou exemplos preocupantes, como instituições financeiras que ainda usam autenticação por voz – facilmente burlada por IA –, além do risco de clonagem de vídeo e áudio para enganar familiares ou até autoridades.

“Estou muito preocupado que tenhamos uma crise significativa de fraudes iminente. Hoje é a voz, amanhã pode ser um vídeo ou uma chamada ao vivo indistinguível da realidade”, afirmou Altman.

Como se proteger de golpes digitais com IA

Com o avanço das ferramentas de inteligência artificial, golpes online estão cada vez mais sofisticados. Veja algumas dicas essenciais para não cair em armadilhas:

- Desconfie de contatos inesperados: se alguém pedir dinheiro ou investimentos por mensagem, confirme por outro canal (ligação direta, vídeo chamada, etc.).

- Cheque a fonte: anúncios ou propostas de emprego devem ser verificados em sites oficiais da empresa ou agências de recrutamento.

- Não confie em voz ou vídeo sozinhos: com deepfakes, golpistas podem imitar até familiares. Sempre confirme detalhes pessoais que só a pessoa real saberia.

- Use autenticação em dois fatores: não dependa apenas de senhas ou biometria de voz. Prefira códigos enviados para celular ou aplicativos autenticadores.

- Atenção a promessas de ganhos fáceis: se parecer bom demais para ser verdade, provavelmente é golpe.

- Eduque familiares: idosos e adolescentes são alvos frequentes. Compartilhe informações e mantenha diálogo aberto.